Как победить скликивание в Я. Директ и AdWords на 600 тысяч рублей в месяц

За последние полгода нам удалось победить «скликивание» нашей контекстной рекламы с бюджетом в 1 миллион рублей в месяц.

Ключом победы над фродом стал поминутный мониторинг трафика с уведомлениями об аномальных изменениях и отключением проблемных объявлений по API, и ряд отчётов, которые отражают ситуацию в реальном времени.

Рисунок 1. Диаграмма количества посетителей по ключевым словам по декаминутам

Как узнать, что вас атакуют?

«В Яндекс Директ расходы на фрод автоматически возвращаются на баланс рекламной кампании. Количество кликов, отсеянных системой защиты от фрода, отображается в отчетах «статистика по дням» «общая статистика» в строке «недействительные клики за весь выбранный период.»

В AdWords отображение уровня «недействительных кликов» можно включить на вкладке «столбцы»:

Рисунок 2. Настроенные столбцы с уровнем «недействительных кликов» в AdWords

В нашем случае, при среднем уровне «недействительных кликов» в Директе ≈ 10%, Яндексе вдруг стал возвращать 40% рекламного бюджета, а через месяц и вовсе 54%.

Следующий признак фрода – это необоснованный рост количества переходов и сильные изменения поведенческих показателей по ряду групп объявлений.

Мы заметили, что по ряду ключевых слов, по которым никогда не было больше 200 посетителей в день, вдруг появились всплески до 3 000 посетителей. По факту, бюджет, в дни подобных активностей, мог уйти на одну рекламную кампанию, если её вовремя не останавливали.

Рисунок 3. Необоснованный рост трафика по определенной группе объявлений в Директ

Яндекс и Google не защищают от фрода

Достаточно прочесть обсуждение уровня фрода в контекстной рекламе в официальном Клубе Директа, чтобы убедиться: многие рекламодатели теряют из-за фрода деньги.

Google официально признаёт ошибки своей системы защиты и предоставляет рекламодателям «Refund Claims» (возврат израсходованного бюджета). По статистике сервиса ClickSease, Google Ads в среднем возвращает 12% рекламного бюджета.

Необходимо отправить жалобу на «недействительные клики» в Адвордс, после рассмотрения которой вам возместят ≈ 12% потраченных средств. Также сервис ClickSease автоматический отправляет в Google подобные требования на возврат денег раз в 2 месяца.

В нашем случае, Google AdWords сначала признал 18% нашего трафика «недействительными» и вернул за них деньги, а когда мы отправили жалобу «refund claims», Google возместил ещё 13% бюджета.

Яндекс же не признаёт уязвимость собственных фильтров защиты и на жалобы об очевидных случаях фрода, отправляет шаблонный ответ, что проблема заключается в рекламодателе и его сайте.

В нашем случае, процент «недействительных кликов» в отчёте Я. Директа никогда не поднимался выше заветных 50% ни по одной из рекламных кампаний, даже в дни самых яростных всплесков, когда 80% бюджета «сливалось» на обычно мало популярную группу объявлений без звонков и заявок.

Рисунок 4. Уровень «недействительных кликов» в одной из кампаний в Директ

С каким уровнем атаки мы столкнулись

Мошеннический трафик направлялся по четырем направлениям бизнеса в двух городах. При подключении новых рекламных кампаний или запуске давно остановленных, в течение нескольких часов «скликивание» перераспределялось и на них.

Click Fraud не привязывался ко времени, и перераспределение бюджета, например на ночь, не давало никакого эффекта: свой объем левого трафика мы всё равно получали. «Скликивание» происходило одинаково активно и в РСЯ, и на поиске Яндекса, и в КМС Google.

На сайте боты симулировали поведение пользователя, переходили по разделам сайта, выделяли текст, естественно скролили и перемещали курсор.

Есть ли готовые средства защиты?

У всех сервисов защиты от кликфрода есть всего один инструмент прямой борьбы – это блокировка подозрительных IP адресов или площадок размещений в кампаниях Я.Директ и AdWords.

В случае, если против вас используются динамические IP, любой сервис борьбы с клик фродом всегда будет отставать на один шаг от мошенников в блокировке их по IP: бот уже совершит несколько кликов по вашей рекламе к тому моменту, когда сервис внесет этот IP в черный список и остановит по нему показ рекламы. К тому же, после того, как мошеннический софт не сможет увидеть вашу рекламу, он просто поменяет IP адрес, Hardware-ID и продолжит свои действия.

При атаке на рекламу в КМС или РСЯ, обычно используются различные места размещения, и системы автоматической защиты не могут обнаружить подозрительных площадок для блокировки.

Вернемся к блокировке по IP – здесь мы подходим к самому интересному – если в AdWords допускается блокировать до 500 IP адресов, то в Яндекс Директ можно блокировать всего лишь 25 уникальных IP адресов на одну рекламную кампанию! Столь маленький черный список IP адресов уже не актуален, так как сейчас можно спокойно закупить 500 IPv4 адресов за 10 тысяч рублей и обойти это ограничение.

Защититься от «скликивания», выполняемого на высоком уровне, можно всего двумя способами:

Отрезать часть аудитории, чтобы сохранить её большую часть

Если научиться не показывать рекламу клик ботам или мошенническим пользователям – то и навредить они не смогут.

Ищем паттерны во фроде через сервисы защиты

Для того, чтобы иметь представление о том, как именно нас атакуют, и вручную отследить закономерности в мошенническом трафике, мы подключили российский сервис защиты от фрода ClickFrog. Продукт это давно всем известный, популярный в среде CPA и так далее.

ClickFrog быстро доказал полную недееспособность:

ClickSease оказался полезнее: он начал вылавливать по 300-400 уникальных мошеннических IP в день. По каждому заблокированному IP сервис отдает статистику:

Ищем паттерны во фроде вручную

Однако даже таких очевидных паттернов оказалось мало для снижения вреда от фрода, да и отключать рекламу на мобильных не хотелось. Сервисы обычно способны только дать идеи по выявлению схожих паттернов во фроде, а дальше необходимо обнаружить фрод в Метрике (в случае атаки на Директ) и выделить его в отдельных сегмент Яндекс Аудиторий для последующего анализа и блокировки.

Рисунок 5. Пример анализа трафика по возрастным группам в Метрике для поиска паттернов фрода

а) вам удалось найти очевидный паттерн фрода, относящийся к полу, возрасту или мобильности:

Строим диаграммы, которые показывают фрод

Фрод всегда порождает очевидные очаги и пики, будь то заумный софт с имитацией поведения настоящего пользователя или группа фрилансеров, выполняющих техническое задание.

Рисунок 6. Диаграмма количества посетителей по ключевым словам по декаминутам

Для визуализации лучше всего подойдёт Google Data Studio, поскольку корректно собирать данные, разбитые по времени на 1 и 10 минут, способен только Analytics, а Метрика, при построении отчетов по декаминутам, отдаёт некорректные показатели.

По умолчанию, в Analytics или Data Studio нельзя строить графики поминутно или по 10 минутам, однако это можно сделать следующим образом в Дата Студии:

Шаг 1. Открываем редактирование полей

Шаг 2. Создаем копии следующих полей: Год, Месяц года, День месяца, Час, Минута, и называем их, например, Год (число), Месяц года (число) и так далее. Также в скопированных полях необходимо изменить Тип с формата времени и даты на „число“ как показано на рисунке.

Шаг 2. Изменяем тип скопированного поля с «даты» на «число»

Шаг 3. Создаем новое поле, в котором прописываем следующую формулу: Год (число)*10000000+Месяц года (число)*100000+День месяца (число)*1000+Час (число)*10+FLOOR(Минута (число)/10)

Шаг 3. Создаём вычисляемое поле «Время по 10 минут»

Шаг 4. Сохраняем созданное поле, затем возвращаемся к списку всех полей и находим наше новое поле «Время по 10 минут (декаминут)». Необходимо изменить его тип с «Число» на «Дата и время» как показано на рисунке, а затем обратно присвоить этому полю тип «Число».

Шаг 4. Создаём вычисляемое поле „Время по 10 минут“

Шаг 5. Создаем «Комбинированную диаграмму» и ставим как параметр наше новое поле «Время по 10 минут», как показано на рисунке. Готово.

Шаг 5. Создаём «комбинированную диаграмму»

Настраиваем уведомления на очаги фрода

Чтобы не следить за всеми случаями фрода вручную, я сделал отчёт в Google Таблицах, который обновляет данные каждую минуту и уведомляет о начале фрода.

Google Таблицы поддерживают Core Reporting API, обращаться к которому можно через «Редактор скриптов» в Таблицах.

Шаг 1. Заходим в редактор скриптов для обращения к Analytics

Рисунок 7. Редактор скриптов для обращения к Analytics Core Reporting API через Гугл Таблицы

Шаг 2. Прописываем API запрос к Analytics, чтобы получать данные о нужных показателях (например, о количестве пользователей, перешедших по платной рекламе, в каждую минуту суток, как в нашем случае).

Шаг 3. Задаем триггер на обновление данных каждую минуту:

Рисунок 8. Запрашиваем свежие данные каждую минуту для оперативного реагирования на фрод

Шаг 4. Создаем сводную таблицу из листа, обновляемого нужными данными раз в минуту, и анализируем эти показатели для настройки триггеров для уведомлений на электронную почту или же отключения групп объявлений по API Я.Директа или AdWords.

Итоги: как победить скликивание

Противодействие клик фроду можно подразделить на три группы:

Любой адекватный конкурент будет минимизировать свой ущерб при атаке на других:

Чтобы было проще анализировать конкурентов, с которыми вы пересекаетесь, можно смотреть все включенные объявления конкурентов по каждому ключевому слову в интерефейсе Директа:

Рисунок 9. Все объявления конкурентов по ключевому слову

Кто также столкнулся со скликиванием контекстной рекламы – пишите в комментариях, постараемся помочь друг другу!

Как скликивают бюджет в контекстной рекламе и что с этим делать

Значительную часть рекламного бюджета (порой до 50%) мы тратим на ботов и нечистоплотных конкурентов.

По сути боты — это тоже грязные происки конкурентов, которые согласились платить таким же грязным сервисам по скликиванию.

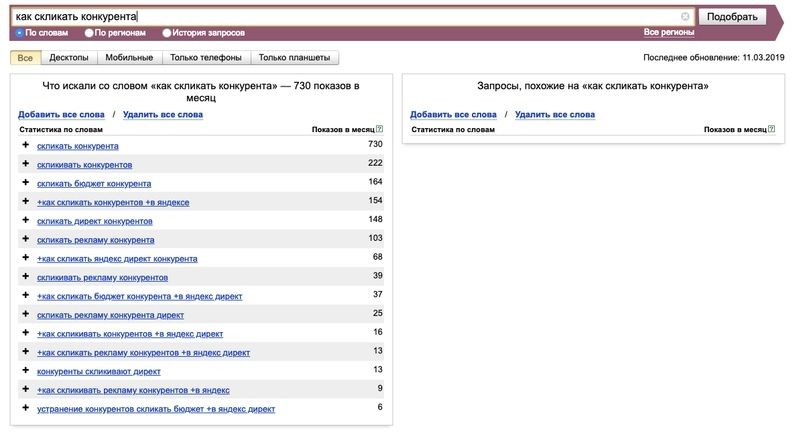

Запросов немного, но они есть. Кому-то проще скликать конкурента, чем придумать более выгодное предложение и конкурировать ценностью. На войне все методы хороши — считают они и оправдывают свои действия.

Я знаю одного человека, который сильно поплатился за это.

Этот человек был моим клиентам до тех пор, пока я не узнал о его намерениях принять приглашение от сервиса по скликиванию конкурентов. Даже сумму обозначил, на то время она составляла 30 тысяч рублей.

Причина банальная и предельно простая:

пока ты платишь подобным сервисам, ты в белых листах и боты тебя обходят, но как только перестаешь платить, сразу оказываешься в блэк-листе. И уж поверьте, вы испытаете всю прелесть на себе, возможно в больших объемах. Никакой пощады:)

Эта тема меня не сильно трогала и на все упоминания о ней я всегда говорил: «в любом случае будет небольшой % склика, надо быть к этому готовым и вносить эту графу в издержки».

Но за последнее время 2 моих клиента столкнулись с сильнейшим скликиванием бюджета.

1) Ремонт DSG (коробки передач) в определенных марках машин (кто знает, тот поймет, что ниша очень узкая).

2) Выкуп автомобилей с пробегом (тут с бюджетом посерьезнее).

Первый всегда инвестировал в рекламу 800-1000 рублей в день и в целом было все хорошо. Звонки шли, приезды были, все довольны.

Второй инвестировал от 4 000 рублей в день и тоже все в ажуре.

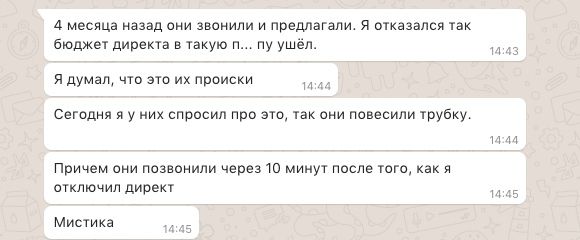

За 2 дня до скликиваний поступил звонок моему клиенту, дословно разговор не помнит, но смысл такой:

«Здравствуйте, вас беспокоит сервис Кликбот, мы занимаемся повышением эффективности рекламных кампаний. Хотите уменьшить стоимость заявки в 2-3 раза? и т.д.»

Иными словами, с помощью данного сервиса вы скликиваете рекламу своих конкурентов и выбиваете их из рекламной выдачи. Сервис мутный, темный, 100% много обмана, но он есть и порядочные предприниматели страдают.

Бюджет слился и дал нулевой результат

После категорического отказа, у обоих клиентов начался коллапс, выраженный повышенным трафиком и безумным ростом бюджета.

Начался рост — это хорошо, думали мы.

Но когда прошло 3 дня и в первом случае было потрачено 10 тысяч рублей вместо 3 тысяч положенных при абсолютно нулевой эффективности, меня это насторожило.

За 4 месяца до этого ситуация была точно такая же, но тогда скликивание продолжалось недолго, поэтому никто сильно не задумался над этим. Все точно так же: звонок, отказ — слив бюджета.

Как ведут себя роботы на сайте

Они сидят на странице от 2 до 5 секунд, бывает что и по 10-15. Отказы увеличиваются, деньги за клик списываются, глубина просмотра уменьшается, поведенческие падают.

Я позвонил менеджеру Яндекса и получил ответ:

«В данный момент повышенный интерес к вашей услуге, поэтому бюджет стал расходоваться больше».

Пошел читать на форум и увидел 1000 похожих ситуаций.

Везде от Яндекса подобные ответы:

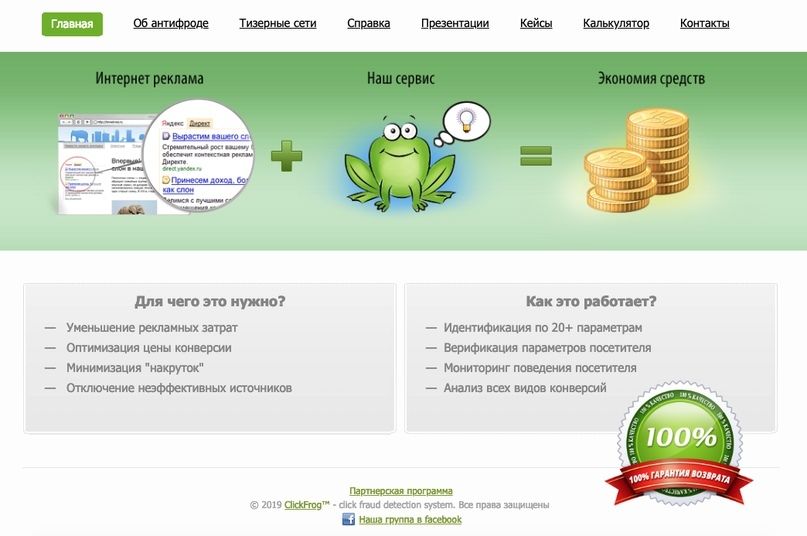

Нельзя винить Яндекс, они тратят огромное количество времени на разработку внутренних алгоритмов для борьбы с подобными сервисами. Иногда возвращают средства на аккаунт, правда зачастую гораздо меньше, чем потрачено на ботов, ну да ладно.

Ботов становится отследить крайне сложно, они используют разные ip адреса, ведут себя на сайте как человек, имеют свой кэш и историю браузера. Более того, они могут быть залогинены и даже могут оставить заявку.

Яндекс знает о существовании подобных сервисов, но к сожалению ничего сделать с ними не может. Или не хочет.

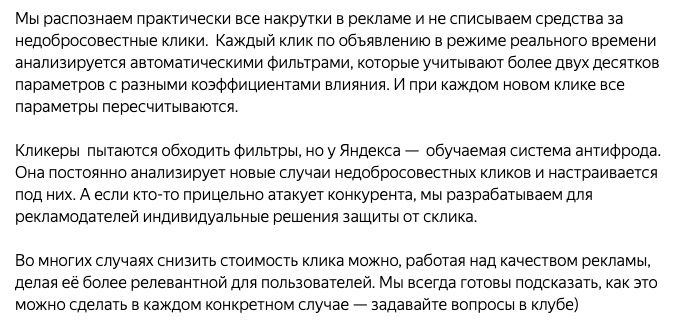

Сервисы по защите от скликивания

С одной стороны, существуют сервисы, которые занимаются блокировкой ботов. Их много, но отзывы неоднозначные. С другой стороны, неужели такой гигант как Яндекс не смог разработать что-то подобное или просто выкупить алгоритм того, что работает.

Например, сервис ClickFrog:

Кому-то он помог и вычистил трафик, кому-то нет, нужно тестировать конкретно у себя.

На форумах и в различных тематических пабликах рекомендуют сервис ClickCease:

Забугорный сервис. Он поможет не только избавиться от атаки ботов, но и отсечь IP адреса конкурентов, которые нет-нет, да перейдут по вашему объявлению. Поверьте, таких много. Работает ClickCease исключительно в системе Google Рекламы.

Если вы знаете еще сервисы, которые занимаются подобной деятельностью, добро пожаловать в комментарии.

Чтобы разобраться самому, я позвонил в сервис ClickFrog и задал наиболее важные вопросы:

1) Каким образом ваш сервис понимает, что зашел бот, когда используется динамические IP адреса и прочие прелести обхода?

2) Чем ваш сервис лучше внутренних алгоритмов Яндекса? Ведь не секрет, что Яндекс располагает более серьезными возможностями.

3) В Яндексе можно заблокировать до 20 ip адресов, но если они все будут динамические, каким образом мы добьемся эффекта?

Записал разговор на видео:

Основные выводы из общения следующие:

1) Если динамические IP адреса у ботов (а они именно динамические), то никаким образом нельзя предотвратить скликивание бюджета.

2) В Яндексе всего 25 запретов ip адресов. То есть, если мы заблокировали 25, то следующая блокировка будет за счет первых. В самом начале выключили нехорошего конкурента, который любил кликать на наше объявление, но потом мы снова его включили.

3) Яндекс пропускает ботов на сайт, т.к. им тоже отчасти это выгодно (по догадкам менеджера ClickFrog).

4) У сервиса ClickFrog нет кейсов и нет отслеживания эффективности работы.

Я изначально написал, что склики должны учитываться при конечной стоимости продукта. Они должны быть заложены в маржу. Сейчас я остаюсь того же мнения.

Можно убрать некоторых конкурентов, которые иногда заходят с одного и того же ip, особенно, когда реклама в дорогой нише, но от ботов с динамическими адресами вы никуда не денетесь.

Кстати, обращение в сервис clickbot.ru (откуда звонили моим клиентам) было безуспешным.

Никто не взял трубку, собственно они на сайте указали, что принимают звонки только от партнеров. После этого я написал им на email с запросом на сотрудничество и тоже тишина.

Они работают только с теми, кому предложили сотрудничество сами. Какие принципиальные. Или боятся возможной атаки на них.

Надеюсь, я еще раскопаю эту тему и будет продолжение. Уверен, что моим клиентам еще не раз они позвонят.

P.S. Если вы докажете Google и Яндексу, что ваш сайт атаковали боты, а с помощью анализа трафика это можно сделать, то есть шанс, что они вернут вам деньги. Но как показывает опыт большого количества людей, в основном на встречу идет только Google. Яндекс открещивается от подобных процедур.

Автор материала — эксперт по контекстной рекламе Иван Криволуцкий.

Как определять и блокировать скликивание рекламы в Яндекс?

Меня зовут Максим Кульгин, и моя компания занимается защитой от скликивания контекстной рекламы. Мы подготовили эту большую статью для тех, кто хочет разобраться с проблемой скликивания рекламы и методиками борьбы с этим печальным явлением. В статье мы рассматриваем в том числе и механизмы обнаружения автоматизированного трафика, т.к. в 90% случаев рекламу скликивают именно с помощью таких инструментов.

Забегая вперед отмечу, что поисковые системы Яндекс и Google проделывают огромную работу по обнаружению кликфрода в своих рекламных сетях и мы не претендуем на то, что наши алгоритмы работают лучше — определение скликивания это вопрос вероятностный и мы здесь исповедуем принцип «лучше перестраховаться», чем допустить «утечку» бюджетов, в отличии от поисковых систем, которые занимают более терпимую позицию (в конечном итоге ведь их цель бизнеса не борьба с фродом, а формирование рекламной биржи между продавцом и покупателем рекламы).

Информационные технологии сегодня играют большую роль в жизни человека и общества, большинство сфер жизни, которые раньше сложно было представить вне физического мира перебрались в Интернет. От онлайн-магазинов до государственных служб все постепенно переходят в сеть. Вместе с ростом количества веб-ресурсов увеличивается и количество информации, которое ими генерируется, среди этой информации может быть множество данных, которые могут представлять коммерческий интерес для злоумышленников или конкурентов. Для оперативного сбора такой информации применяются веб-роботы, генерирующие автоматизированный трафик, тек самым, создавая проблемы веб-ресурсам.

Автоматизированный трафик на веб-ресурсах бывает разный. Есть хорошие роботы поисковых систем, которые не нагружают сайт, а также продвигают его для пользователей сети. А есть вредительский, который конкуренты, либо злоумышленники используют в своих целях.

Автоматизированный сбор информации с веб-ресурсов, иными словами – парсинг, приносит на данный момент много забот различным компаниям и организациям. Цели парсинга всегда различны – кто-то хочет получить какую-либо уникальную статистику, для дальнейшей обработки и использовании, кто-то мониторит цены конкурентов, а кто-то хочет таким образом обойти платные функции ресурса, либо использовать уникальные данные на своём ресурсе. Как раз последние виды парсинга больше всего не нравятся компаниям, но и причины не любить безобидный парсинг тоже есть. Например, парсинг может нагружать систему, из-за чего придётся докупать ресурсы для более стабильной работы, эта проблема в большей степени касается маленьких компаний, но и большие не очень рады тратить свои ресурсы в угоду своим конкурентам или в интересах чужого бизнеса. Кроме этого, парсинг портит статистику сайта, особенно если недобросовестные парсеры начинают добавлять товары интернет-магазина в корзину.

Кроме парсинга, роботизированный трафик может использоваться для кликфрода (скликивания рекламы) или рекламных бюджетов на рекламных площадках, с целью убрать конкурента, либо заработать на своей площадке. Робот создаёт человеческий трафик на сайте, обманывая системы аналитики, затем переходит по рекламным ссылкам расходуя бюджет конкурента в своих целях. Можно сказать, что проблема скликивания рекламы является наиболее финансово значимой для всех компаний, не зависимо от сферы их работы.

На данный момент доля автоматизированного трафика в Интернете составлял 56%, то есть пользователей в сети меньше, чем роботов, и эта цифра продолжает расти. А доля маркетинговых расходов в цифровых медиа в 2019 году составила 51%. Растущие показатели использования автоматизированного трафика показывают актуальность выдвинутой проблемы.

Цель данной статьи – обрисовать наши некоторые методы обнаружения автоматизированного трафика с рекламы, провести классификацию этих методов и предложить на её основе некую универсальную модель системы защиты от такого трафика (в основном надо защищаться от скликивания, ведь этот тип трафика несет явные финансовые убытки).

Задачи, которые необходимо было решить для достижения цели защиты:

Практическая значимость заключается в разработке на основе предложенной модели и с использованием рассмотренных методов, системы детектирования и блокирования скликивания рекламы на цифровых рекламных площадках Яндекса (скликивание рекламы в Google можно блокировать аналогичными механиками).

Современные системы по защите сайтов от нежелательного трафика в основном нацелены на защиту от DDoS атак и более меньшей степени могут противостоять намеренной краже контента, так как такие системы всё чаще мимикрируют под обычных пользователей и стараются не сильно увеличивать нагрузку на сайт.

Из известных на данный момент решений для защиты является сервис CloudFlare. CloudFlare – американская компания, предоставляющая услуги CDN, защиту от DDoS-атак, безопасный доступ к ресурсам и серверы DNS. Сервис представляет собой облако, промежуточное звено между пользователем и сайтом, в случае обнаружения атаки система блокирует доступ к сайту для конкретного пользователя, защищая инфраструктуру веб-ресурса от падения. Принцип работы системы представлен на рисунке ниже. Защита от ботов и недобросовестного сбора информации не является главными инструментами этого сервиса, так что он не может гарантировать высокой эффективности против парсинга.

Ещё один популярный американский сервис – это Distil Networks, он нацелен на блокировку ботов, и защиту от автоматизированного сбора информации. Данная система уже нацелена на более эффективную защиту от ботов, предлагает системы защиты не только сайта, но API. Использует в своём арсенале капчу и блокировку трафика, после анализа активности.

Такие сервисы как Distil Networks хоть и предлагают хорошую систему защиты, однако работают вне России, а также не могут влиять на некоторые факторы защиты сайта, как например, доступ по логину, скрытие информации о блокировке (т.е. бот получает информацию, но не достоверную). А некоторые сферы как скликивание не имеют эффективных существующих решений. Необходимо также отметить, что все эти решения представляют собой сторонние компоненты, которые встраиваются на сайт и не дают полного контроля над ситуацией. Поэтому крайне актуально дать веб мастерам структурированные решения, модели и алгоритмы для построения собственных систем защиты, учитывающие множество факторов.

Бот-программы (или просто, «боты») всё искуснее имитируют поведение клиента на сайте: могут набрать URL, прийти с самого авторитетного ресурса и отправить товар в корзину, позвонить, заполнить анкету, добавить сайт в бот-сеть, украсть контент, опередив индексацию от Google.

Рассмотрим наиболее типичные ситуации бот-атак в сети:

Приём 1. Сбор ценной информации с сайта, для дальнейшего использования в собственных целях, регулирование ценовой политики конкурентного магазина, перепродажа данных в иной форме и другое коммерческое использование обработанной информации.

Приём 2. Накрутка поведенческого фактора. Боты, призванные совершить на сайте массовые действия за короткий промежуток времени, для того чтобы дать поисковым системам негативный сигнал. Поисковая система (Google, Яндекс), проанализировав странные переходы из другой страны, посчитает это «накруткой» поведенческого фактора – конечно, условно сто ботов, не достаточно для того чтобы отправить сайт в БАН, но может хватит, чтобы запомнить его, как ресурс с плохой репутацией и высоко не ранжировать.

Приём 3. Повышение количества отказов. Боты-даунлодеры, на первый взгляд являются самыми примитивными (просто загружают и через несколько секунд покидают страницу сайта), но вместе с тем, наиболее болезненными из-за динамической смены IP-адреса. В данном случае поисковик посчитает, что ваш сайт просто не интересен пользователям целевой аудитории. Обиднее всего, что именно они, чаще всего съедают и без того небольшой рекламный бюджет.

Приём 4. Снижение оригинальности ресурса. Бот-парсер «тихо» посещает сайт, сканирует и публикует контент на сторонних ресурсах ещё до официальной индексации, при этом не эмулируя действий посетителей. Вследствие чего сайт не поднимается в поисковой выдаче.

Приём 5. Мошеннические клики (скликивание) по рекламным объявлениям с оплатой за клик для получения незаконной платы с рекламодателя. Мошенничество с кликами связано с обманным получением денег с рекламодателей за клики по их объявлениям, отсюда и название модели. В 2017 году примерно каждый пятый клик по рекламным объявлениям был мошенническим, и это число непрерывно увеличивается с каждым месяцем. Мошенничество с кликами не только увеличивает расходы на рекламу, но также искажает аналитические данные, на которые многие компании полагаются для принятия эффективных маркетинговых решений.

На рисунке 2 можно увидеть график отношения рекламного трафика (черная линия) к общему (синяя), график показывает среднее между примерно сорока сайтами разных направленностей с установленной системой аналитики, к которым у нас есть доступ (то есть это сайты, которые мы защищаем от скликивания).

Можно заметить, что в среднем рекламный трафик – это пятьдесят процентов от общего, а значит скликивание рекламы может приносить не только финансовые потери, но и лишать большой части трафика, и как следствие, если это интернет-магазин, то он ещё и не получит прибыль от возможных продаж.

В качестве эксперимента мы провели «атаку» на собственный сайт, предварительно установив на него систему по контролю за активностью пользователей «Яндекс Метрика» со включенным вебвизором. Вебвизор – это дополнительный инструмент платформы Яндекс Метрика, позволяющий следить не только за параметрами посещений, но и за активностью пользователей на самом сайте в том числе переходы по страницам, время нахождения на сайте, а также трекинг движений мыши.

Эксперимент проводился в двух различных конфигурациях. Первая конфигурация представляла из себя многопоточную программу, использующую автоматизированное управление браузером Google Chrome, без использования прокси, переходы осуществлялись в пять потоков. Вторая конфигурация была аналогична первой за исключением того, что теперь браузеру в случайном порядке подавался список из нескольких десятков открытых прокси из разных стран.

Для начала обратимся к данным собранным вебвизором. На рисунке 3 видно, что Яндекс определил, чётко пять посещений (по одному на браузер), каждый из которых прошёлся примерно по пятидесяти страницам. Здесь сразу можно отметить одну из особенностей свойственных роботам или другим автоматизированным системам – это слишком короткое время нахождения на одной странице. Примерно семьдесят секунд на пятьдесят посещений – это меньше двух секунд на страницу, что крайне несвойственно человеку.

Перейдя к результатам парсинга с использованием прокси перед нами предстоит другая картина (рисунок 4). Здесь теперь выделено множество различных пользователей с точки зрения метрики, у каждого из которых не более десяти просмотра. Ситуация с коротким временем на страницу также сохраняется.

Если нажать на «+» можно раскрыть карту переходов (рисунок 5) и заметить, что происходить обход всех страниц сайта друг за другом в сторону увеличения. Эта особенность есть как у первой, так и у второй конфигурации, только во втором случае это отследить труднее так, как разделение на множество различных посещений не дает это понять.

Ещё одной отличительной особенностью, которую позволяет выявить вебвизор, является полное отсутствие движений мышки. У некоторых посещений треугольная кнопка серая, что означает, что мышь даже не была зафиксирована, а у тех, у которых кнопка активна, можно нажать и убедиться, что она стоит статично. Кстати, многие программы для скликивания научились делать эмуляцию движения мышкой, но при этом она не хаотичная (хотя не так уж сложно программно добавить чуть-чуть хаоса:).

Рисунок 4 – Данные вебвизора для парсера с использованием прокси